语音识别部分

一、标志性的Whisper

openAI做的转录模型,开源,而且可以输出SRT。当时出来了减轻了很多字幕组的工作量。但是在今天的精度已经比不过如qwen3-asr等模型。

仓库:https://github.com/openai/whisper

我之前很喜欢的一个GUI页面:https://github.com/CheshireCC/faster-whisper-GUI

我之前在用的打轴+翻译工具整合包(基于Whisper): https://www.bilibili.com/video/BV1MWhGz5Ej9

faster-whisper 模型下载:https://huggingface.co/models?sort=trending&search=faster-whisper

二、准确率大幅提高的Qwen3-ASR

Qwen3的这个ASR在当时刚出来的时候效果很惊艳,就是不支持带时间轴的SRT格式,但是也有项目使用切分功能间接支持了时间轴,就是精度不是太细。现在依然有很多人用这个作为主力。

仓库:https://github.com/QwenLM/Qwen3-ASR

官方的一个工具箱:https://github.com/QwenLM/Qwen3-ASR-Toolkit

模型下载:https://huggingface.co/collections/Qwen/qwen3-asr

本地部署整合包的一个教程:https://www.bilibili.com/video/BV1UDffBbE2G

三、新秀vibevoice ASR——微软出品,甚至有语音输入法

2026-01-21: 📣 We open-sourced VibeVoice-ASR, a unified speech-to-text model designed to handle 60-minute long-form audio in a single pass, generating structured transcriptions containing Who (Speaker), When (Timestamps), and What (Content), with support for User-Customized Context. Try it in Playground.

- ⭐️ VibeVoice-ASR is natively multilingual, supporting over 50 languages — check the supported languages for details.

- 🔥 The VibeVoice-ASR finetuning code is now available!

- ⚡️ vLLM inference is now supported for faster inference; see vllm-asr for more details.

- 📑 VibeVoice-ASR Technique Report is available.

比较新的模型,但是有说话人识别、时间戳、自定义上下文等功能,最长支持60分钟的录音。我在playground里试用了一下,效果确实很不错,就是暂时没看到整合包或者云端部署教程。

试用地址:https://d677a8c4456fb55738.gradio.live/

另外他们还用这个做了一个语音输入法,效果应该没豆包那个快,但是至少是开源的。

TTS部分

这一部分的开源/闭源项目有很多了,我就只写我用过的,但是大伙可以自行修改文档。

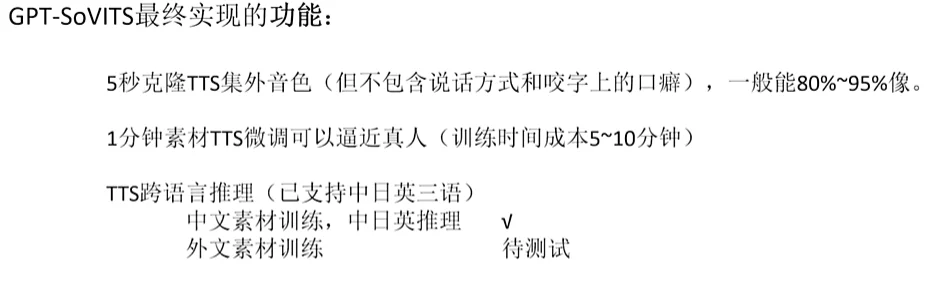

一、GPT-SoVITS——夯中夯,极低成本就可以复刻音色

这东西当时出来我就震惊了,原来SoVITS对数据集的要求是很高的。而这个只需要大约1分钟的素材就可以有很好的效果,到现在我都还在用。主要是因为indextts2支持的语言比较少。

原作者视频:https://www.bilibili.com/video/BV12g4y1m7Uw/

Github地址:https://github.com/RVC-Boss/GPT-SoVITS

二、B站开源的indextts2

B这个开源的项目音色还原程度上更好,更强调情感控制。但是因为语种较少,所以我还是更喜欢前者。

整合包:https://www.bilibili.com/video/BV1znjRzLEGb/

仓库地址:https://github.com/index-tts/

三、新王Qwen3TTS

Qwen出的这个热度比较高,另外本地部署的要求也不是很高。虽然说还是有点小问题,但是输出的音频还是比较干净的。另外就是语种也非常丰富。但是情感表达上感觉不如前两者,未来可期吧。

效果展示:https://www.bilibili.com/video/BV1eT6BBYEZ2/

仓库地址:https://github.com/QwenLM/Qwen3-TTS/tree/main

变声部分(Sound to Sound)

一、标志性的So-VITS

AI翻唱的开山鼻祖,功不可没,就是调试的成本较高,对数据集的要求也较高。如果数据集较少或者处理不好,出来的效果也比较灾难。

仓库地址:https://github.com/innnky/so-vits-svc

二、成本极低的RVC

夯中夯,我用的最久的AI翻唱项目。对显卡的要求很低,另外低延迟的特性使得很多实时变声器都是基于RVC二开而来的。同时对于数据集的要求也很低,十分钟的数据足以有很好的效果。

仓库地址:https://github.com/innnky/so-vits-svc

三、成本更低的DDSP

说实话这个项目我只是浅尝了一下,印象中对显卡和数据集的要求更低,但是在我自己测试的效果是不如RVC的。可能和个人训练的数据集也有关系

仓库地址:https://github.com/yxlllc/DDSP-SVC

其他工具

一、MSST WebUI

音频分离工具,可分离音乐和人声,有的模型还可以分离各种乐器和人声。

我用的是这个版本:https://github.com/AliceNavigator/Music-Source-Separation-Training-GUI

教程:https://www.bilibili.com/video/BV197njzqExb/

其他待补充^^